สอน AI ให้เป็นคนดี

หากเป็นเมื่อ 10 ปีก่อน เราคงนึกไม่ออกว่า AI (Artificial Intelligence) จะเกี่ยวข้องกับชีวิตประจำวันของคนทั่วไปได้อย่างไร จากหุ่นยนต์สังหารในภาพยนตร์ฮอลลีวู้ด วันนี้เทคโนโลยี AI ออกจากห้องแล็บมาสู่สมาร์ทโฟนในมือเรา ไปจนถึงอุปกรณ์อัจฉริยะทั้งในบ้านและนอกบ้าน มันรู้ภาษาที่เราใช้ คาดเดาพฤติกรรมล่วงหน้า แยกแยะใบหน้าคนจากฝูงชนนับพัน บริษัท Gartner คาดการณ์ว่า 10 ปีนับจากนี้ปัญญาประดิษฐ์จะแทรกซึมในทุกมิติของชีวิต และทุกหนทุกแห่ง

ขณะเดียวกันก็เกิดการถกเถียงอย่างกว้างขวางว่าเมื่อ AI วิวัฒน์ไปถึงจุดที่ฉลาดเหนือมนุษย์แล้ว จะเป็นจุดจบของมนุษยชาติหรือไม่ เรย์ เคิร์ซวีล (Ray Kurzweil) นักอนาคตศาสตร์ชื่อดัง และผู้อำนวยการฝ่ายวิศวกรรมเบื้องหลังโปรเจ็กต์ AI ของกูเกิลเคยทำนายไว้ว่าปี 2045 อารยธรรมของมนุษย์-เครื่องจักรจะรุ่งเรืองถึงขีดสุด และเข้าสู่ยุคของซิงกูลาริตี้ (Singularity) ซึ่งไม่มีใครทํานายได้ว่าจะเกิดอะไรขึ้นต่อไป ที่สำคัญหนทางสู่ซิงกูลาริตี้ได้เริ่มต้นแล้ว ด้านทำเนียบขาว รัฐสภาแห่งสหภาพยุโรป และรัฐบาลอีกหลายประเทศทั่วโลกก็ได้เร่งเตรียมแผนรับมือเชิงนโยบายและกฎหมายควบคุมหุ่นยนต์และปัญญาประดิษฐ์

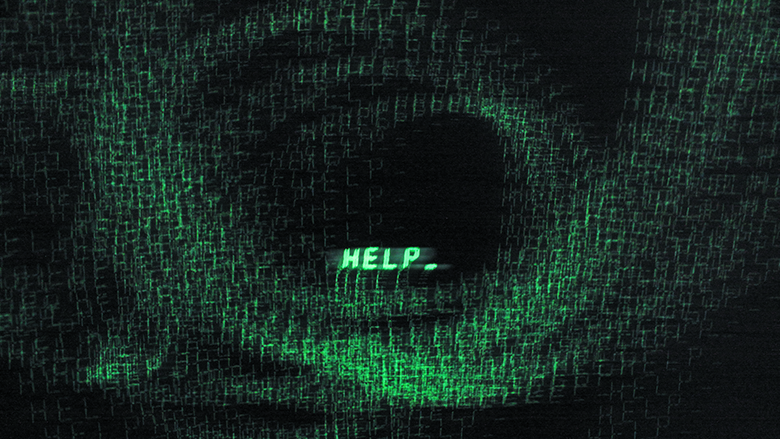

คำถามคือ เราจะสร้าง AI ที่ไม่ย้อนกลับมาทำร้ายมนุษย์ในวันหน้าได้ไหม และอย่างไร

บทที่ 1 การเรียนรู้ของเครื่อง: แมว หมา และหมากล้อม

ถ้าเป็นเมื่อ 10 ปีก่อน นักวิจัยเองก็แทบนึกภาพไม่ออกเช่นกันว่าคอมพิวเตอร์จะแยกแยะความแตกต่างระหว่างรูปภาพของสุนัขกับแมวซึ่งต่างก็เป็นสัตว์สี่ขาได้อย่างไร โจเซฟ เรดมอน (Joseph Redmond) นักวิทยาศาสตร์คอมพิวเตอร์จากบริษัท YOLO ได้เล่าถึงโปรเจ็กต์ทดลองให้ผู้ชมในงานเท็ดทอล์กฟังว่า ปัจจุบันระบบคอมพิวเตอร์วิชันสามารถระบุว่ารูปไหนเป็นสุนัขและแมวได้แม่นยำถึง 99% (ระบุสายพันธุ์ได้อีกต่างหาก) นี่คือความก้าวหน้าของ Image Classification หรือการสอนให้คอมพิวเตอร์จำแนกประเภทของรูปภาพโดยป้อนรูปและแคปชั่นเข้าไป โจเซฟได้ทดลองเพิ่มระบบ Object Detection ทำให้มันแยกแยะได้ว่ามีทั้งสุนัข แมว และหนังสือในรูปเดียวกัน แต่การพัฒนารถยนต์ขับอัตโนมัติต้องอาศัยสิ่งที่ซับซ้อนกว่าระบบคอมพิวเตอร์วิชัน และต้องทำงานประสานกับเซ็นเซอร์มากมายนับไม่ถ้วนเพื่อประมวลผลวัตถุและการเคลื่อนไหวทั้งหมด การทดสอบรถไร้คนขับได้จุดประเด็นคำถามเชิงจริยธรรมอย่างเข้มข้น เพราะ AI จะต้องเป็นฝ่ายตัดสินใจรักษาความปลอดภัยของผู้ขับและชีวิตอื่นๆ บนท้องถนน ในทัศนะของมนุษย์ทุกชีวิตล้วนมีค่า แต่เราไม่อาจล่วงรู้ได้เลยว่า AI จะตัดสินใจอย่างไร

การแยกแยะรูปภาพแมวกับสุนัขคงไม่สั่นสะเทือนวงการมากเท่ากับข่าว AlphaGo Zero ปัญญาประดิษฐ์เซียนโกะเวอร์ชั่นใหม่ของ DeepMind รอบนี้มันสามารถเรียนรู้การเล่นเกมหมากล้อมเองโดยไม่ต้องพึ่งข้อมูลการเล่นเกมของคนเลย

ถ้ายังจำกันได้ก่อนหน้านี้ทีมงานDeepMind เคยสอนให้ AlphaGo ศึกษารูปแบบการเล่นของผู้เล่นระดับมืออาชีพจนระบบสามารถเรียนรู้ได้เอง ด้วยเทคนิค Deep Learning ผนวกกับ Reinforcement Learning จนในที่สุดก็เอาชนะลี เซโดลแชมป์หมากล้อมชาวเกาหลีใต้ในปี 2016 ในปีนี้ AlphaGo Zero ฝึกแข่งหมากล้อมกับตัวเองโดยใช้โครงข่ายประสาทเทียมที่ไม่มีความรู้เกี่ยวกับหมากล้อมเลย จากนั้นจึงเริ่มใช้ระบบอัลกอริทึมอันทรงประสิทธิภาพที่ใช้ในการค้นหาความเป็นไปได้ ทำให้มันคาดเดาการเดินหมากล่วงหน้าได้อย่างรวดเร็ว ยิ่งแข่งเยอะ ก็ยิ่งค้นพบจุดเด่นจุดด้อยไว จนสมารถพัฒนาการเล่นในเกมถัดไปดีขึ้นเรื่อยๆ ชนิด 'ไร้ที่ติ' แค่ 3 วัน AlphaGo Zero ก็เอาชนะ AlphaGo รุ่นเก่าที่เคยโค่นลี เซโดล และเวอร์ชั่นอื่นทั้งหมดภายใน 40 วัน!

อย่าพึ่งตกใจว่า AI จะฉลาดเกินมนุษย์แล้ว เพราะ AlphaGo และปัญญาประดิษฐ์ในโครงการทดลองอื่นๆ ยังจัดอยู่ในระดับความสามารถเฉพาะทาง (Narrow Artificial Intelligence) หรือ Norrow AI อธิบายง่ายๆ ก็คือ มันมีทักษะความเชี่ยวชาญจำกัดเฉพาะบางเรื่อง บางสาขาเท่านั้น แต่ยังห่างไกลจาก AI ที่รู้คิดเชิงเหตุผล และบูรณาการศาสตร์ความรู้หลากหลาย หรือทำทุกอย่างได้เหมือนกับมนุษย์ (Artificial General Intelligence: AGI) หรือ Strong AI อย่างไรก็ดี นิค บอสตรอม (Nick Bostrom) นักเขียนนักคิดผู้คร่ำหวอดในวงการนี้ชี้ว่าจุดเปลี่ยนผ่านจาก Strong AI ไปสู่ระดับสติปัญญาเหนือมนุษย์ (Artificial Super Intelligence: ASI) หรือ Super AI จะเกิดขึ้นแบบก้าวกระโดดในระยะเวลาสั้นมากๆ

Super AIจะมีพัฒนาการทั้ง 3 ด้าน ได้แก่ ระดับสติปัญญา (Intelligence) ระดับจิตสำนึก (Consciousness) และระดับการหยั่งรู้ตนเอง (Self-Awareness) ว่ามันเป็นใครหรือสิ่งใด หนึ่งในวิธีการทดสอบยอดนิยมคือ แบบทดสอบของทัวริง (Turing Test) โดยอลัน ทัวริง นักคณิตศาสตร์ชื่อดัง ผู้ได้รับการยกย่องให้เป็นบิดาแห่งวิทยาการคอมพิวเตอร์ ทัวริงพยายามค้นหาคำตอบว่าคอมพิวเตอร์คิดได้หรือไม่ (Can machine think?) และได้เสนอแนวคิดนี้ในบทความ “Computing Machinery and Intelligence” ว่าด้วยแบบทดสอบวัดความฉลาดของคอมพิวเตอร์ หากผู้ทดสอบไม่สามารถแยกแยะได้ว่ามีมนุษย์โต้ตอบในบทสนทนาหรือไม่ ก็จะถือว่าคอมพิวเตอร์นั้นผ่านการทดสอบ และมีสติปัญญาเฉกเช่นมนุษย์

บทที่ 2: AI ก็มีหัวใจ?

ปัจจุบันมีกลุ่มนักวิจัยที่เห็นตรงกันว่าการพัฒนา AI ให้มีความฉลาดทางอารมณ์ และเข้าใจความรู้สึกของคน หรือ Emotion AI จะเป็นกุญแจสำคัญที่พา AI ขยับเข้าใกล้ความเป็นมนุษย์ ริชาร์ด ยองค์ (Richard Yonck) ผู้เขียนหนังสือ Heart of the machine: our future in a world of artificial emotional intelligence มองว่าอารมณ์เป็นหัวใจของความเป็นมนุษย์ ทุกวันนี้ AI อยู่ในชีวิตประจำวันแล้ว และจะเข้ามาเป็นส่วนหนึ่งในครอบครัวของเราด้วยซ้ำ การออกแบบเทคโนโลยีให้เข้าใจอารมณ์ความรู้สึกของคนจึงเป็นเรื่องสำคัญ

ไม่ใช่แค่แวดวงนักวิจัยและนักวิชาการที่ตื่นตัวกับเรื่องนี้ บริษัทใหญ่ๆ อย่างเช่น Huawei, Samsung, Apple และ Amazon ต่างก็ทุ่มงบในการวิจัยพัฒนาซอฟต์แวร์ของระบบผู้ช่วยอัจฉริยะ (Voice Assistant) ให้ปฏิสัมพันธ์กับอารมณ์ของผู้ใช้ทุกรายในอนาคต เพื่อยกระดับการมอบประสบการณ์ที่ตรงใจผู้ใช้มากที่สุด (Personalised User Experience) การพัฒนา Emotion AI ส่วนใหญ่ใช้การวิเคราะห์ข้อมูลจากการตรวจจับสีหน้า ท่าทาง น้ำเสียง และรูปแบบพฤติกรรมของคน ทางฝั่งเฟซบุ๊กและยูทูบเองก็มีข่าวลือว่ากำลังซุ่มพัฒนาด้านนี้เพื่อให้คนเสพติดคอนเทนต์และอยู่บนแพลตฟอร์มนานที่สุด รายงาน Affective Computing Market เปิดเผยว่ามูลค่าตลาดของระบบคอมพิวเตอร์ ซอฟต์แวร์และฮาร์ดแวร์ที่เกี่ยวข้องกับ Emotion AI จะเติบโตจาก 12,200 ล้านเหรียญสหรัฐฯ เป็น 53,980 ล้านเหรียญในปี 2021 เช่น ระบบรู้จำเสียง (Speech Recognition) ระบบรู้จำท่าทาง (Gesture Recognition)

เฟย เฟย ลี (Fei-Fei Li) ผู้อำนวยการสถาบันวิจัยด้าน AI มหาวิทยาลัยสแตนฟอร์ด หัวหน้านักวิทยาศาสตร์ฝ่าย Google Cloud มองประเด็นนี้ว่าเป็นภารกิจที่ยากยิ่ง ลำพังแค่ความรู้ด้านคอมพิวเตอร์ (Computer Science) ย่อมไม่เพียงพอที่จะพัฒนา AI ให้เรียนรู้อารมณ์ความรู้สึกของมนุษย์ได้เลย นั่นหมายความว่าเราจะได้เห็นโปรแกรมเมอร์ทำงานร่วมกับผู้เชี่ยวชาญสาขาอื่นๆ อีกมากมาย เธอเชื่อมั่นว่าการพัฒนาเทคโนโลยีปัญญาประดิษฐ์ไปในทิศทางที่ดีควรจะยึดโยงมนุษย์เป็นศูนย์กลาง (Human-centered AI) โดยประการแรก AI จะต้องสะท้อนความฉลาดของมนุษย์ได้อย่างลึกซึ้ง คำนึงถึงการมองโลกผ่านสายตาของมนุษย์ เพราะเครื่องจักรยังเรียนรู้ได้จำกัด บ่อยครั้งที่การทดลองล้มเหลวเป็นเพราะ AI ขาดความเข้าอกเข้าใจ (Empathy) ไม่สามารถรับรู้แง่งามหรือสัมผัสความลึกซึ้งของสิ่งรอบตัวซึ่งเป็นสิ่งที่มนุษย์ชื่นชมกันเป็นปกติ

ประการที่สอง การสร้าง Human-centered AI ควรอยู่บนแนวคิดการนำเทคโนโลยีมาใช้เพิ่มประสิทธิภาพของตนเอง ไม่ใช่มาแทนที่ เธอได้ยกตัวอย่างว่าการใช้หุ่นยนต์ผ่าตัดนั้นไม่ควรเป็นระบบอัตโนมัติที่จะทำทุกอย่าง แต่เป็นผู้ช่วยคอยแบ่งเบาภาระงานบางส่วนที่ทำให้เกิดความเหนื่อยล้า ความประมาท และทำให้แพทย์มีสมาธิในการผ่าตัดดีขึ้น

ประการสุดท้าย การพัฒนาปัญญาประดิษฐ์ต้องดำเนินควบคู่ไปกับการคำนึงถึงผลกระทบที่จะเกิดขึ้นกับมนุษย์เสมอ

บทส่งท้าย: อคติทางเพศ ชาติพันธุ์ และประชาธิปไตย

จะมีอะไรที่น่ากลัวยิ่งกว่าอุปกรณ์อัจฉริยะแสนฉลาดในบ้านที่ลุกขึ้นมาทำร้ายเราตอนนอนหลับ ไม่มีใครอยากให้ฝันร้ายนี้กลายเป็นจริงแน่ๆ

ก่อนที่ จอห์น จิอันนันเดรีย (John Giannandrea) หัวหน้าฝ่ายวิศวกรรม AI ของกูเกิล จะย้ายมาทำงานให้กับ Apple ในฐานะหัวหน้าฝ่าย Machine Learning and AI Strategy เขาเคยกล่าวเตือนในงานประชุมของกูเกิลว่าหุ่นยนต์สังหารยังไม่น่ากังวล เมื่อเทียบกับ AI ที่มีอคติ (Bias) ซึ่งอคตินั้นก็มาจากการเรียนรู้ข่าวสารข้อมูลบนโลกออนไลน์ที่เต็มไปด้วยอคติทางเชื้อชาติ เพศ และอุดมการณ์ทางการเมือง กล่าวโดยสรุปคือเกิดจากน้ำมือของมนุษย์นั่นเอง

ถ้ายังจำกันได้ กรณีข่าวปลอมระบาดในช่วงการเลือกตั้งประธานาธิบดีสหรัฐฯ ก็เป็นตัวอย่างหนึ่งของการใช้ประโยชน์ของอัลกอริทึมในทางที่ผิด แลกมาด้วยบทเรียนราคาแพง ลองคิดต่อว่าจะเกิดอะไรขึ้นถ้าหาก AI ในชีวิตประจำวันของเรา มีอคติต่อเพศใดเพศหนึ่ง หรือเชื้อชาติใดเชื้อชาติหนึ่ง ผลลัพธ์ที่ตามมาย่อมหนีไม่พ้นความขัดแย้งโกลาหล เมื่อถึงจุดนั้นมนุษย์อาจจะไม่ไว้ใจเทคโนโลยีอีกต่อไป จึงเป็นเรื่องสำคัญมากที่ทีมวิจัยจะคัดกรองและตรวจสอบข้อมูลให้เกิดความโปร่งใส ปราศจากอคติ และสอนให้ AI เรียนรู้ที่จะแยกแยะข้อมูลลวงและมีอคติได้เช่นกัน เพื่อหลีกเลี่ยงการสร้างระบบปัญญาประดิษฐ์ที่มีอคติขึ้นมา ทางรัฐสภาแห่งสหราชอาณาจักรได้เสนอประเด็นดังกล่าวต่อรัฐบาลให้เร่งกำหนดจริยธรรมการพัฒนาและการใช้เทคโนโลยี AI และดำเนินมาตรการตอบโต้ด้วยเครื่องมือและระบบป้องกันเพื่อรับมือกับการแพร่ระบาดของ AI ที่มีอคติในอนาคต

ยังไม่มีบทสรุปว่าการพัฒนา AI ที่ปราศจากอคติทุกๆ ด้านจะลงเอยอย่างไร เฟย์ เฟย์ ลี กล่าวว่าวงการวิจัยด้าน AI ควรจะสนับสนุนให้มีนักวิจัยหญิงมากกว่านี้ เพื่อลดอคติทางเพศ บางคนมองว่าการใช้เสียงผู้หญิงในระบบผู้ช่วยส่วนตัวเป็นการเหยียดเพศอย่างหนึ่ง ทั้ง Siri และระบบปฏิบัติการอื่นๆ มักจะถูกถามเชิงล่อแหลม หยาบคาย หรือแม้แต่ถูกล่วงละเมิดทางเพศผ่านคำพูด ที่สำคัญมันไม่ได้ถูกโปรแกรมหรือสอนให้โต้ตอบปฏิเสธต่อการล่วงละเมิดอย่างเหมาะสมเท่าที่ควร มีนักคิดนักวิจัยเสนอว่าการสร้าง AI นั้นไม่ควรระบุเพศ (Neutral Gender) หรือไม่มีเพศเลย (Genderless) เพื่อส่งเสริมความเท่าเทียมอย่างแท้จริง

มีอีกหลายบทเรียนที่ AI ต้องเรียนรู้จนกว่ามันจะเข้าใจและหลีกเลี่ยงอคติของมนุษย์ ก่อนจะถึงเวลานั้นเราอาจต้องเริ่มจากละวางอคติของตนเองลงก่อน สุดท้ายแล้วปัญญาประดิษฐ์จะเป็นตัวสะท้อนถึงวิวัฒนาการและเนื้อแท้ของมนุษย์เอง

ที่มา:

ภาษาไทย

บทความ “Deep Reinforcement Learning: Is the Future Perfect?” โดย Sopon Supamangmee จาก bookster.blog

หนังสือ “ประวัติศาสตร์ปรัชญา ฉบับกะทัดรัด” โดย ไนเจล วอร์เบอร์ตัน

ภาษาอังกฤษ

การบรรยาย “How Computers Learn to Recognize Objects Instantly” โดย Joseph Redmon จาก ted.com

บทความ “Affective Computing Market Worth 53.98 Billion USD by 2021” จาก marketsandmarkets.com

บทความ “AlphaGo Zero: Learning from Scratch” จาก deepmind.com

บทความ “China's Largest Smartphone Maker Is Working on an A.I. That Can Read Human Emotions” โดย Uptin Saiidi จาก cnbc.com

บทความ “Forget Killer Robots-Bias Is the Real AI Danger” โดย Will Knight จาก technologyreview.com

บทความ “From Narrow to General AI” โดย Peter Voss จาก medium.com

บทความ “Google AI Chief Claims Biased Algorithms Are a Big Danger” โดย Ken Hanly จาก digitaljournal.com

บทความ “How to Make A.I. That’s Good for People” โดย Fei-Fei Li จาก nytimes.com

บทความ “If We Want Humane AI, It Has to Understand All Humans” โดย Davey Alba จาก wired.com

บทความ “The Rise of Emotionally Intelligent AI” โดย Mikko Alasaarela จาก machinelearnings.co

หนังสือ “Heart of the Machine: Our Future in a World of Artificial Emotional Intelligence” โดย Richard Yonck

เรื่อง: ปิยพร อรุณเกรียงไกร